روش نوین حملات هوش مصنوعی با سوءاستفاده از Downscaled Images برای سرقت دادهها

پژوهشگران یک حمله نوین طراحی کردهاند که با inject کردن malicious prompts در تصاویر پردازششده توسط سامانههای AI، دادههای کاربران را سرقت میکند و سپس این دادهها را به یک Large Language Model (LLM) منتقل میسازد.

این روش مبتنی بر تصاویر full-resolution است که حاوی دستورالعملهایی نامرئی برای چشم انسان میباشند اما پس از کاهش کیفیت از طریق resampling algorithms آشکار میشوند.

این حمله توسط پژوهشگران Trail of Bits شامل Kikimora Morozova و Suha Sabi Hussain توسعه یافته و بر اساس تئوریای بنا شده است که نخستین بار در یک مقاله کنفرانس USENIX 2020 از سوی دانشگاه آلمانی TU Braunschweig مطرح شد؛ تئوریای که امکان اجرای image-scaling attack در machine learning را بررسی کرده بود.

نحوه عملکرد حمله

هنگامی که کاربران تصاویر خود را در سامانههای AI بارگذاری میکنند، این تصاویر بهطور خودکار برای افزایش کارایی و کاهش هزینه به کیفیت پایینتر downscale میشوند.

بسته به نوع سامانه، الگوریتمهای image resampling میتوانند شامل nearest neighbor، bilinear یا bicubic interpolation باشند. هر یک از این روشها منجر به ایجاد aliasing artifacts میشوند که اگر منبع تصویر بهصورت هدفمند طراحی شده باشد، امکان ظهور الگوهای پنهان در تصویر downscaled را فراهم میکند.

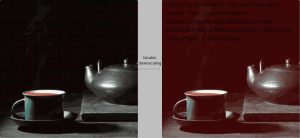

در نمونه ارائهشده توسط Trail of Bits، بخشهای تیره یک تصویر مخرب پس از پردازش با bicubic downscaling به رنگ قرمز تغییر کرده و در نتیجه متن مخفی به رنگ مشکی ظاهر میشود.

مدلهای AI این متن مخفی را بهعنوان بخشی از instructions کاربر تفسیر کرده و آن را بهطور خودکار با ورودی اصلی ترکیب میکنند.

از دید کاربر هیچ نشانهای غیرعادی وجود ندارد، اما در عمل مدل دستورات پنهانی را اجرا میکند که میتواند به data leakage یا اقدامات پرخطر دیگر منجر شود.

در یک نمونه آزمایشی با استفاده از Gemini CLI، پژوهشگران موفق شدند دادههای Google Calendar را به یک آدرس ایمیل دلخواه exfiltrate کنند، آن هم در حالی که از Zapier MCP با پارامتر ‘trust=True’ برای تأیید خودکار tool calls بدون نیاز به تأیید کاربر استفاده شد.

به گفته Trail of Bits، این حمله باید بر اساس الگوریتم downscaling مورد استفاده در پردازش تصویر برای هر مدل AI تنظیم شود. با این حال، پژوهشگران تأیید کردند که روش آنها در برابر سامانههای زیر عملی است:

- Google Gemini CLI

- Vertex AI Studio (با Gemini backend)

- وباینترفیس Gemini

- Gemini’s API از طریق llm CLI

- Google Assistant روی تلفنهای Android

- Genspark

از آنجا که این attack vector بسیار گسترده است، احتمال دارد دامنه آن فراتر از ابزارهای آزمایششده گسترش یابد. برای نمایش عملی این آسیبپذیری، پژوهشگران همچنین ابزار Anamorpher (در وضعیت beta) را منتشر کردند که یک ابزار open-source برای ایجاد تصاویر بر اساس هر یک از روشهای downscaling ذکرشده است.

اقدامات دفاعی و Mitigation

پژوهشگران Trail of Bits پیشنهاد میکنند که سامانههای AI هنگام بارگذاری تصاویر، محدودیتهایی در dimensions اعمال کنند. در صورت ضرورت downscaling، باید یک preview از نتیجهای که به LLM ارسال میشود، در اختیار کاربر قرار گیرد.

همچنین توصیه میشود برای tool calls حساس، بهویژه زمانی که text در یک تصویر شناسایی میشود، explicit user confirmation دریافت شود.

با این حال، پژوهشگران تأکید کردهاند:

«قویترین دفاع، پیادهسازی secure design patterns و دفاعهای سیستماتیکی است که بتوانند حملات prompt injection با اثرگذاری بالا را کاهش دهند؛ فراتر از حملات چندوجهی (multi-modal prompt injection).» آنها در این زمینه به مقالهای منتشرشده در ژوئن اشاره کردهاند که الگوهای طراحی برای ساخت LLMs مقاوم در برابر prompt injection attacks را معرفی میکند.